Crie um

Self-Improving Agent

Uma API compatível com OpenAI para rotear, rastrear e avaliar cada requisição — com todos os principais provedores. Envie mais inteligente, pague menos.

Gratuito para sempre · Sem cartão de crédito · Cloud ou self-host

Compatível com todos os principais provedores

Tudo que você precisa para

escalar IA com confiança

Roteie, rastreie, avalie e destile — uma plataforma, todos os provedores, sem lock-in de fornecedor.

One endpoint. Every LLM provider.

One OpenAI-compatible API that routes to every major provider. Swap providers in one line. Automatic fallbacks keep you online when things go sideways.

import opentracy as ot # Call any model — one line response = ot.completion( model="openai/gpt-4o-mini", messages=[{"role": "user", "content": "Hello!"}], fallbacks=["anthropic/claude-3"] ) print(response.choices[0].message.content) print(f"Cost: ${response._cost:.6f}")

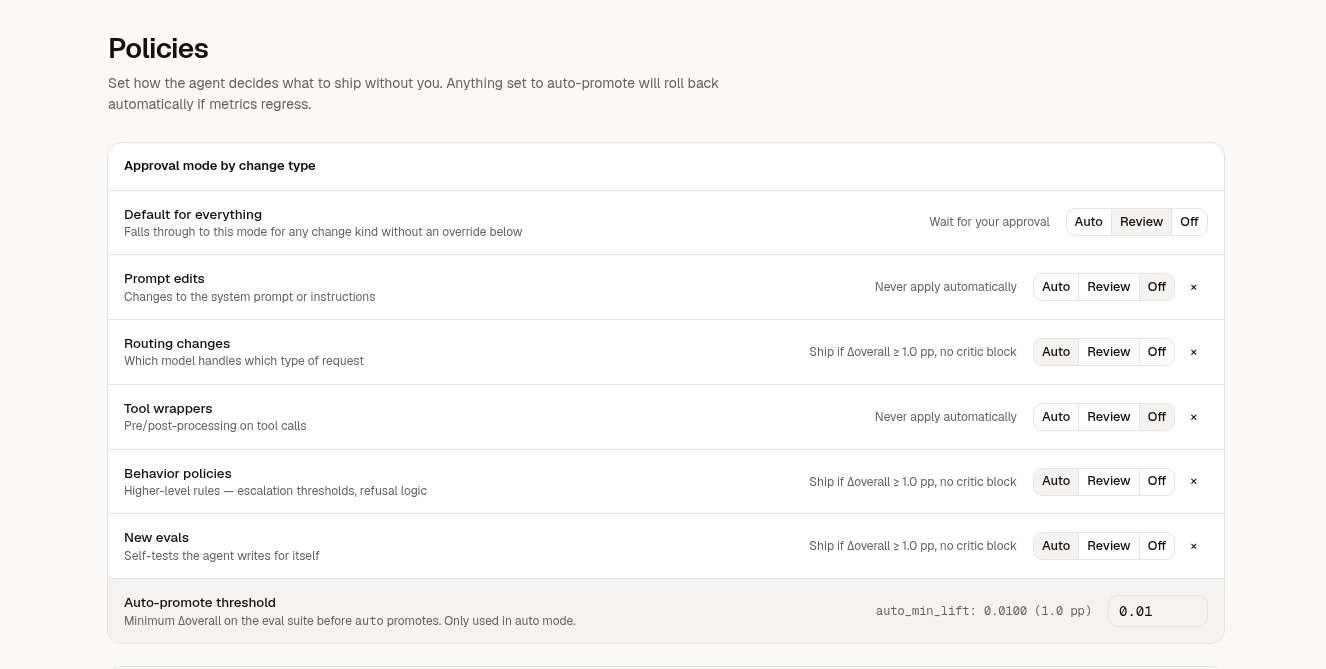

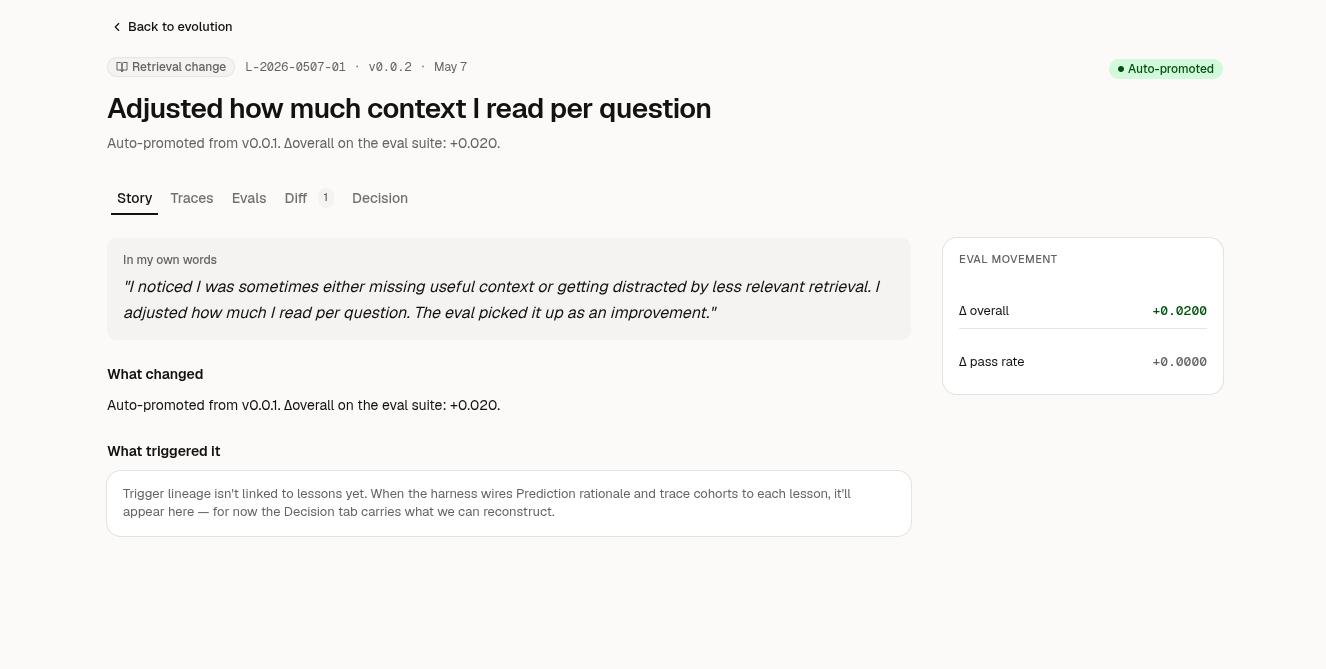

Route smarter. Pay less.

Automatically send simple prompts to fast, cheap models and route complex reasoning to the most capable one - across any provider, no code changes.

Know where every dollar goes.

Per-token pricing on 300+ models, broken down by model, user, or feature. Set budget alerts and hard caps - no more end-of-month surprises.

Complete visibility into every request.

Every request logged with full input, output, cost, latency, and model metadata. AI-powered scanning detects hallucinations before your users do.

Explore live traces

Train your own model.

Turn production traces into fine-tuning datasets automatically. Get frontier-model quality from a model you own - at a fraction of the cost.

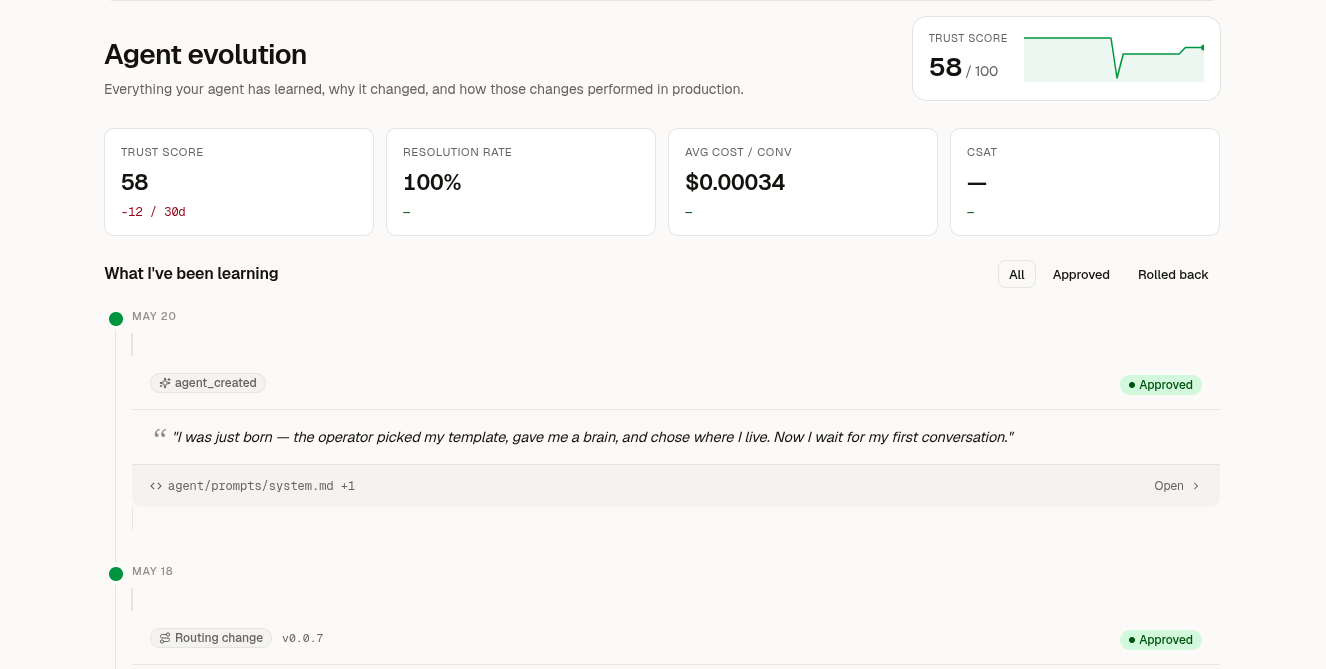

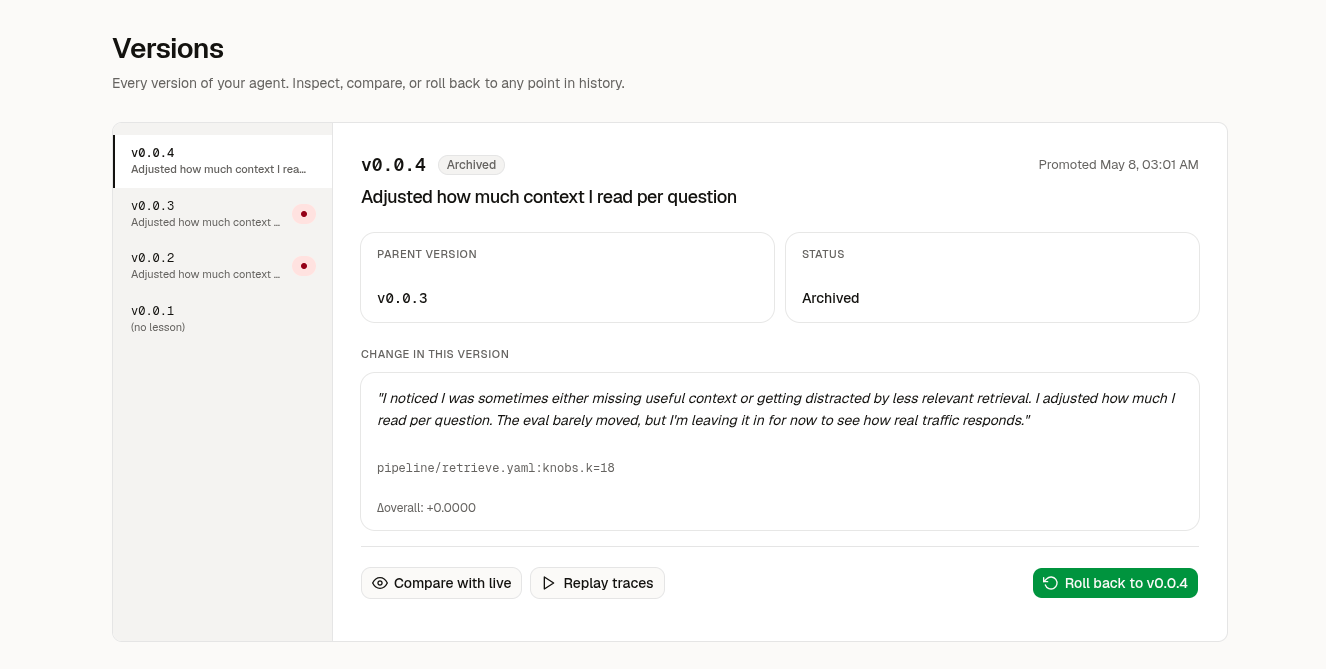

Catch drops before users do.

Continuous evaluations on production traffic detect regressions and hallucinations automatically. Set thresholds, get alerts, stay confident.

Simples. Transparente.

Comece grátis. Escale quando estiver pronto. Sem taxas ocultas.

Perfeito para projetos paralelos e experimentação.

- 13 provedores

- 300+ modelos

- 10k requisições/mês

- Análises básicas

- Suporte da comunidade

Para times lançando produtos reais com usuários reais.

- Tudo no Gratuito

- 500k requisições/mês

- Roteamento inteligente

- Rastreamento de custos e alertas

- Suporte prioritário

Para implantações de IA em grande escala com necessidades personalizadas.

- Requisições ilimitadas

- Destilação de modelos

- SSO e SAML

- SLA e suporte dedicado

- Opção on-premise

Perguntas frequentes

Answers to the most common pricing and deployment questions.

O que conta como uma requisição?

Cada chamada de API pelo OpenTracy conta como uma requisição. Tanto chamadas bem-sucedidas quanto com falha são contabilizadas.

Posso fazer self-host do OpenTracy?

Sim. O OpenTracy é código aberto (MIT). Você pode hospedar todo o stack com Docker. Os planos Starter e Enterprise adicionam recursos gerenciados.

Quais provedores são suportados?

OpenAI, Anthropic, Google Gemini, Mistral, Groq, AWS Bedrock, Azure OpenAI, Cohere, DeepSeek, Together AI, Fireworks, Ollama e OpenRouter.

Como funciona o teste gratuito?

14 dias de recursos Starter, sem cartão de crédito. Após o teste, você migra para o plano Grátis automaticamente.

Meus dados estão seguros?

Sim. Certificação SOC 2 Type II, conformidade com GDPR. Planos Enterprise incluem deploy em VPC e criptografia BYOK.

Posso trocar de plano a qualquer momento?

Sim. Faça upgrade ou downgrade a qualquer momento. As mudanças entram em vigor no próximo ciclo de cobrança.

Junte-se à comunidade

Código aberto, desenvolvimento aberto. Construa conosco.

Código aberto. Self-host ou nuvem.

Execute na sua própria infraestrutura com controle total, ou use nossa nuvem gerenciada. Licença MIT, sem vendor lock-in.

Plano gratuito disponível. Sem cartão de crédito.